மூன்றாவது பொம்மை:

டீப் லேர்னிங் (Deep Learning)

செய்யறிவுப் புரட்சியின் உண்மையான பொறி (Engine). பல அடுக்குகளைக் கொண்ட செய்நரவலைகளால் (Artificial Neural Networks) மனித மூளையைப் போலவே ஆழமாகச் சிந்திப்பது.

Interactive Python Examples · Live Code Execution

16. படிநிலைக் கற்றல் (Hierarchical Learning)

ஏன் இது "ஆழமானது"? ஆழம் என்பது செயலாக்க அடுக்குகளின் (Layers) எண்ணிக்கையைக் குறிக்கிறது. ஒரு சிக்கலான விஷயத்தைப் படிப்படியாகப் பிரித்துப் புரிந்துகொள்ளுதல்.

அடுக்கு 1 (கீழ்மட்டம்)

படத்தின் அடிப்படை அம்சங்களான கோடுகள், விளிம்புகள், வண்ணப் புள்ளிகளைக் கற்றுக்கொள்கிறது.

அடுக்கு 2 (இடைப்பட்ட நிலை)

கோடுகளை இணைத்து கண்கள், காதுகள், மூக்கு போன்ற சற்று சிக்கலான வடிவங்களை உணர்கிறது.

அடுக்கு 3 (மேல்மட்டம்)

அனைத்தையும் இணைத்து, இது ஒரு 'பூனை' என்ற முழுமையான கருத்தைப் புரிந்துகொள்கிறது.

16a. பெர்செப்ட்ரான்: கடற்கரை முடிவு

ஞாயிற்றுக்கிழமை மாலை. களைப்பைத் தணிக்கக் கடற்கரை சென்று காற்று வாங்க முடிவு செய்கிறீர்கள் என்று வைத்துக்கொள்வோம். இதைத் தீர்மானிக்க உங்கள் மூளை முக்கியமாகப் பின்வரும் மூன்று காரணிகளை அலசுகிறது:

வானிலை (x₁)

வெளியே நல்ல வானிலையா, அல்லது மழையா?

x₁ = 1 (நல்ல வானிலை)

x₁ = 0 (மழை)

நண்பன் (x₂)

உங்கள் நண்பனோ தோழியோ உங்களுடன் வர விரும்புகிறாரா?

x₂ = 1 (வருவார்)

x₂ = 0 (வரமாட்டார்)

போக்குவரத்து (x₃)

பொதுப் போக்குவரத்து (பஸ்/ரயில்) அருகில் கிடைக்கிறதா?

x₃ = 1 (கிடைக்கும்)

x₃ = 0 (கிடைக்காது)

இந்த மூன்று காரணிகளையும் நமது பெர்செப்ட்ரானுக்கு x₁, x₂, x₃ ஆகிய பைனரி (0 அல்லது 1) மாறிகள் மூலம் உள்ளீடாகக் கொடுக்கலாம்.

16b. எடைகளின் மாயாஜாலம்

உங்கள் முன்னுரிமைகளுக்கு ஏற்ப எடைகளை (Weights) நிர்ணயிப்போம். வானிலை மிக முக்கியம் என்று வைத்துக்கொள்வோம்:

எடைகள் & மதகு

w₁ = 6 → வானிலை

w₂ = 2 → நண்பன்

w₃ = 2 → போக்குவரத்து

Threshold = 5

முடிவு எடுக்கும் முறை

∑ = (w₁×x₁) + (w₂×x₂) + (w₃×x₃)

∑ ≥ 5 → 1 (செல்லலாம்)

∑ < 5 → 0 (வேண்டாம்)

16c. பெர்செப்ட்ரான் செயல்பாட்டில்

இரண்டு வேறுபட்ட சூழல்களை எடுத்துக்கொண்டு, நமது பெர்செப்ட்ரான் எப்படி முடிவெடுக்கிறது என்று பார்ப்போம்:

சூழல் 1: நல்ல வானிலை ☀️

x₁ = 1 (நல்ல வானிலை)

x₂ = 0 (நண்பன் இல்லை)

x₃ = 0 (போக்குவரத்து இல்லை)

∑ = (6×1) + (2×0) + (2×0) = 6

6 > 5 → வெளியீடு: 1

✓ கடற்கரைக்குச் செல்லலாம்!

சூழல் 2: கனமழை 🌧️

x₁ = 0 (மழை)

x₂ = 1 (நண்பன் வருவார்)

x₃ = 1 (போக்குவரத்து உண்டு)

∑ = (6×0) + (2×1) + (2×1) = 4

4 < 5 → வெளியீடு: 0

✗ வீட்டிலேயே இருங்கள்!

முக்கிய புரிதல்: எடைகள் (Weights) மற்றும் மதகு அளவை (Threshold) மாற்றுவதன் மூலம், ஒரு இயந்திரத்தின் ஒட்டுமொத்த முடிவெடுக்கும் குணாதிசயத்தையே நம்மால் மாற்றிவிட முடியும்!

17. ஆழக் கற்றலின் முக்கியக் கட்டமைப்புகள்

CNN (சுருள் செய்நரவலை)

"ஆழக் கற்றலின் கண்கள்"

படங்கள், காணொளிகள் போன்ற காட்சித் தரவுகளைப் பகுப்பாய்வு செய்வதில் நிபுணத்துவம் பெற்றவை.

பயன்பாடு: முக அங்கீகாரம் (Face ID), மருத்துவ ஸ்கேன் (MRI), கார்களில் சாலையைக் கண்டறிதல்.

RNN (தொடர் செய்நரவலை)

"ஆழக் கற்றலின் காதுகளும் வாயும்"

மொழி, பேச்சு, பங்குச் சந்தை போன்ற தொடர்ச்சியான (Sequential) தரவுகளைக் கையாள்வதில் சிறந்தவை.

பயன்பாடு: குரல் உதவியாளர்கள் (Siri), தானியங்கி மொழிபெயர்ப்பு, Chatbots.

18. புரட்சிக்கு வித்திட்ட மூன்று தூண்கள்

நரம்பியல் வலைப்பின்னல்கள் என்ற ஐடியா பல ஆண்டுகளாக இருந்தாலும், அதைப் பயிற்றுவிக்கச் சமீபத்திய 3 முன்னேற்றங்களே உதவின:

- பெருந்தரவுகள் (Big Data): ImageNet போன்ற கோடிக்கணக்கான லேபிளிடப்பட்ட படங்களின் தரவுத்தளங்கள் மாபெரும் உணவாக அமைந்தன.

- சக்திவாய்ந்த வன்பொருள் (GPUs): வீடியோ கேம்களுக்காக உருவாக்கப்பட்ட GPU-க்கள் ஒரே நேரத்தில் ஆயிரக்கணக்கான கணக்குகளைச் செய்து பயிற்சி நேரத்தைக் குறைத்தன.

- மேம்பட்ட அல்காரிதம்கள் (Algorithms): Backpropagation போன்ற நுட்பங்களில் ஏற்பட்ட முன்னேற்றங்கள் ஆழமான வலைப்பின்னல்களைப் பயிற்றுவிக்க வழிவகுத்தன.

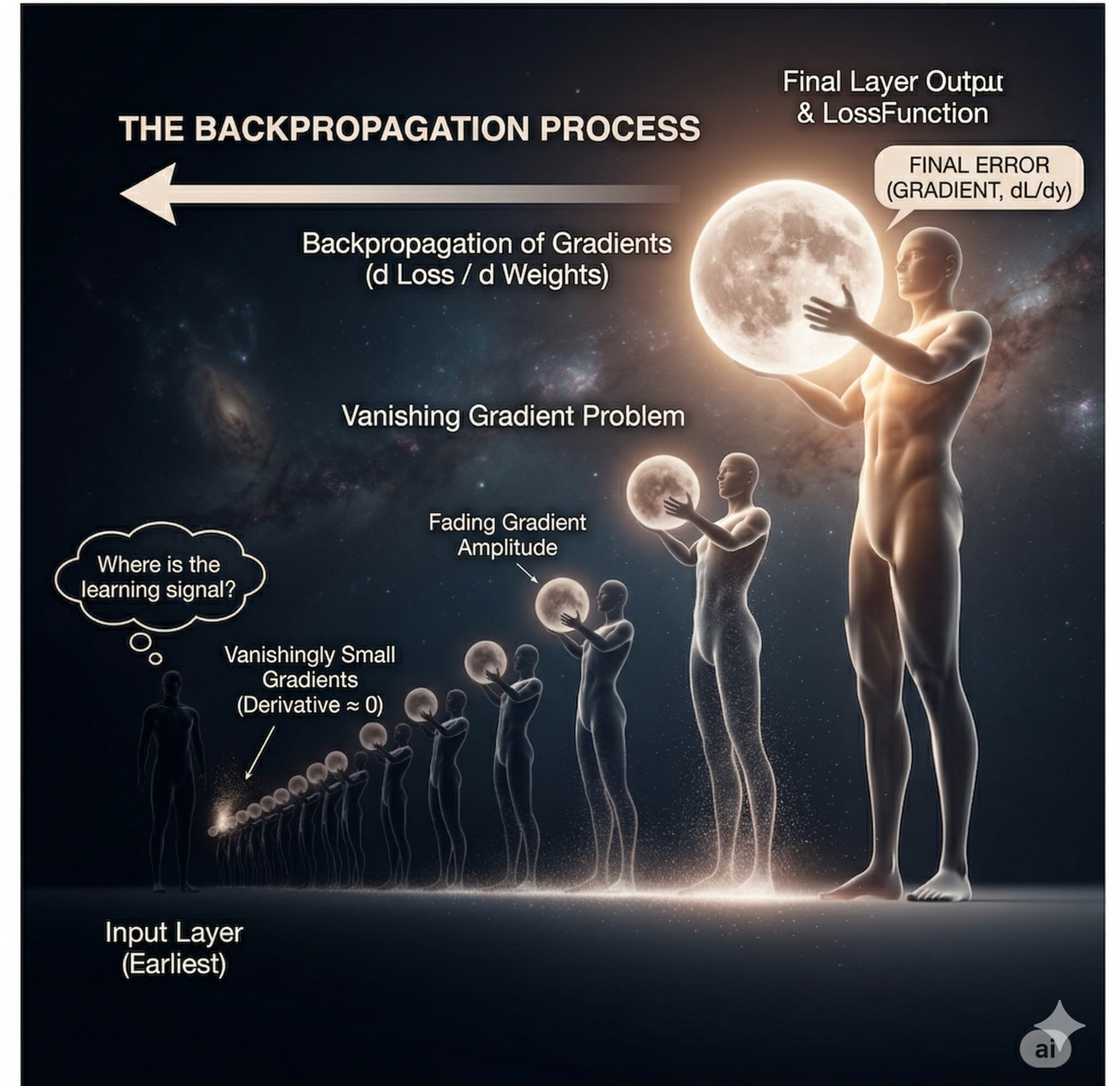

19. Vanishing Gradient Problem

Whisper Down the Lane

பிழைத் தகவல் (Gradient) கடைசி அடுக்கிலிருந்து முதல் அடுக்குக்குப் பின்னோக்கிச் செல்லும்போது (Backprop), அதன் மதிப்பு மெல்ல மெல்லக் குறைந்து முதல் அடுக்கில் 'சுழியமாக' மறைந்துவிடுகிறது (Vanish).

நீண்ட வரிசையில் நிற்கும் நபர்களிடம் ஒரு ரகசியத்தைச் சொல்லும்போது, அது முதல் நபரைச் சென்றடையும் முன் சிதைந்து போவதைப் போல!

இதனால்தான் பல ஆண்டுகளாக ஆழமான வலைப்பின்னல்களைப் பயிற்றுவிக்க முடியவில்லை. இன்று ReLU, LSTM போன்ற நுட்பங்கள் இதைத் தீர்த்துள்ளன.

நான்காவது (மையப்) பொம்மை:

ஜெனரேட்டிவ் AI (Generative AI)

பகுத்தறியும் AI (Discriminative - "இது பூனையா?") vs உருவாக்கும் AI (Generative - "புதிய பூனையை உருவாக்கு!"). படைப்பாற்றலின் புதிய சகாப்தம்.

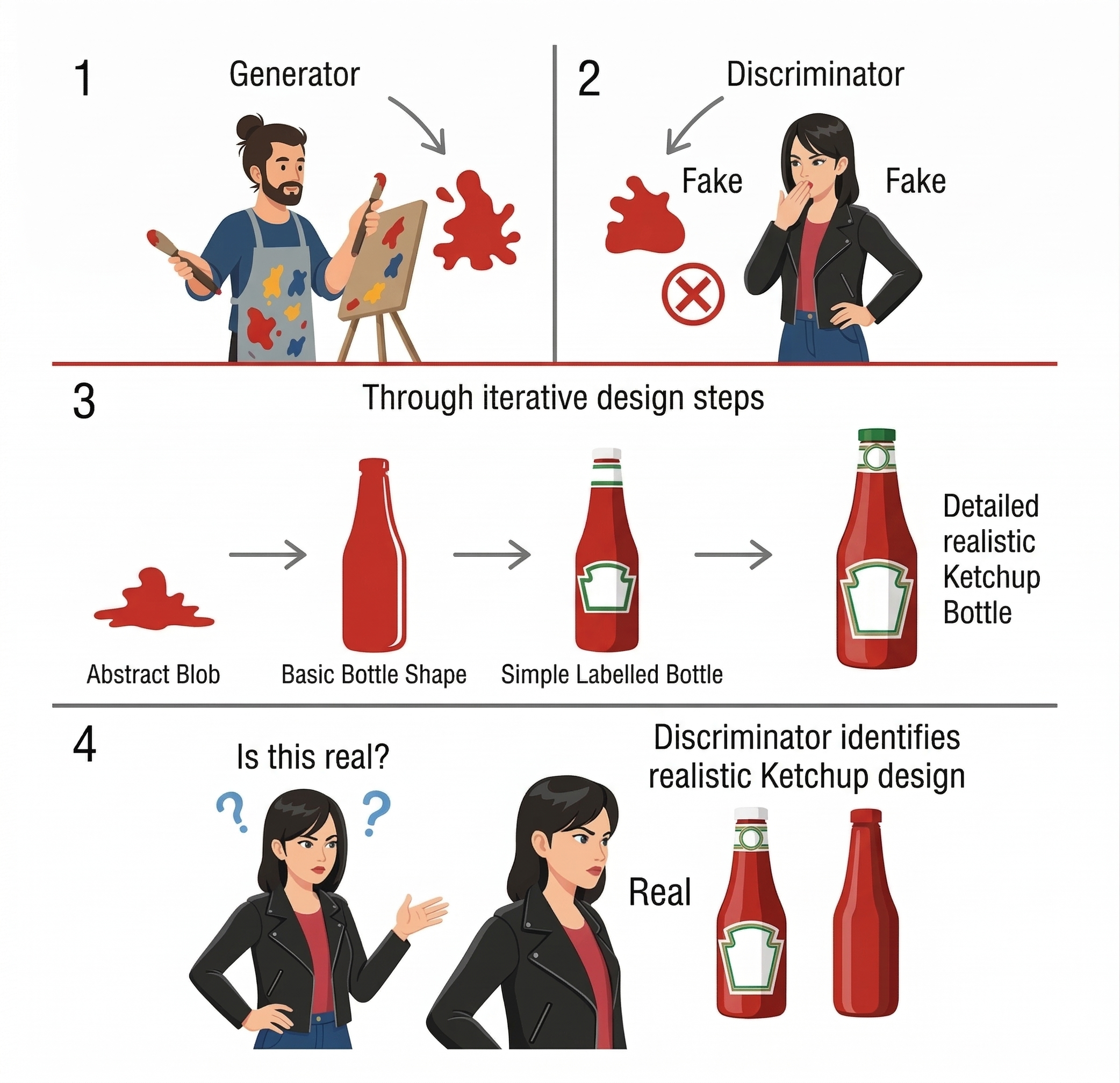

20. GANs: கலைஞனும் விமர்சகனும்

Generative Adversarial Networks (GANs)

2014-ல் இயன் குட்ஃபெலோ அறிமுகப்படுத்திய கணினிகளின் “கற்பனைத் திறன்”. இதன் அடிப்படை இரண்டு AI-களுக்கிடையேயான போட்டி!

- ஜெனரேட்டர் (கலைஞன்): இதன் வேலை, உண்மையான படைப்புகளைப் போலவே, புதிய போலிப் படைப்புகளை உருவாக்குவது.

- டிஸ்கிரிமினேட்டர் (விமர்சகன்): இதன் வேலை, உண்மையான படைப்பையும், போலிப் படைப்பையும் ஒப்பிட்டு, எது போலி என்பதைக் கண்டுபிடிப்பது.

21. GAN-களின் கற்றல் சுற்று & சவால்கள்

கெட்சப் பாட்டில் பயிற்சி

முதல் முயற்சி: கலைஞன் களிம்பு போல ஒன்றை வரைகிறான். விமர்சகன் "இது போலி" என நிராகரிக்கிறான்.

ஆயிரக்கணக்கான முயற்சிகள்: கலைஞன் பாடம் கற்றுக்கொண்டு பாட்டில் வடிவத்திற்கு முன்னேறுகிறான். ஒரு கட்டத்தில் விமர்சகனாலேயே உண்மையா, பொய்யா எனப் பிரிக்க முடிவதில்லை!

படைப்பாற்றலின் இருமுனைக் கத்தி

- Deepfakes: போலியான செய்தி வீடியோக்களை உருவாக்கிச் சமூகத்தில் குழப்பம் ஏற்படுத்துதல்.

- Mode Collapse: கலைஞன் ஒரே ஒரு உத்தியை மட்டும் கற்றுக்கொண்டு, அதையே திரும்பத் திரும்ப உருவாக்குதல்.

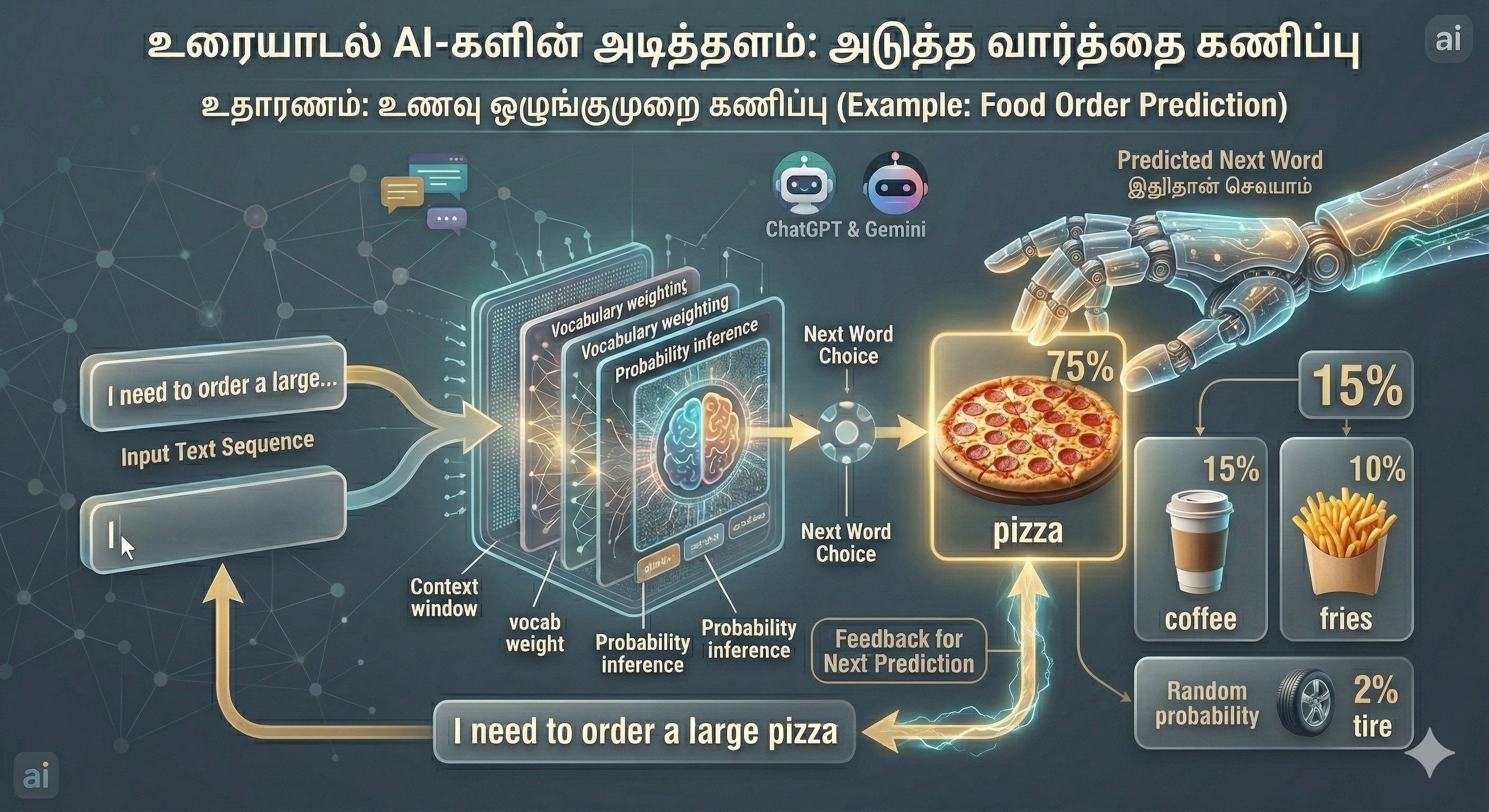

22. டிரான்ஸ்ஃபார்மர்கள் மற்றும் LLM-கள்

இதுவே இன்று நாம் காணும் ChatGPT, Gemini போன்ற உரையாடல் AI-களின் அடித்தளம்.

- அடுத்த வார்த்தையைக் கணிப்பது (Next-Token Prediction): இணையப் பக்கங்களைப் படித்து, புள்ளியியல் ரீதியாக அடுத்த வார்த்தையை ஊகிப்பது.

- கவனத்தின் சக்தி (Attention Mechanism): நீண்ட வாக்கியத்தில் எந்த வார்த்தைகளுக்கு அதிக முக்கியத்துவம் கொடுக்க வேண்டும் என்பதைத் தீர்மானிக்கிறது.

உ-ம்: "மலைகளின் ராணியான ஊட்டி, மிகவும் குளிர்ச்சியாக இருந்தது" - குளிர்ச்சியாக என்பதை ஊட்டியோடு இணைத்துப் புரிதல்.

23. அளவின் அற்புதம் (The Miracle of Scale)

வெளிப்படும் திறன்கள் (Emergent Abilities)

GPT-3 போன்ற மாதிரிகளில் 175 பில்லியன் அளவுருக்கள் (Parameters / Dials) உள்ளன. தரவுகளின் அளவு ஒரு எல்லையைத் தாண்டும்போது, வெறும் வார்த்தைகளைக் கணித்துக்கொண்டிருந்த இயந்திரம், மலையளவு தரவுகளுக்குள் ஒளிந்திருக்கும் தர்க்கங்களைத் தன்னிச்சையாகப் புரிந்துகொள்கிறது.

"மழை பெய்ததால், ____"

சாதாரண மாதிரி: "தெருக்கள் நனைந்தன" (எளிய கணிப்பு)

மேம்பட்ட LLM: "குழந்தைகள் காகிதங்களுடன் வெளியே ஓடினர்; ஓடைகள் சலசலத்தன" (சூழலைப் புரிந்த கற்பனை)

அடுத்த படி: இயல் மொழி செயலாக்கம் (NLP)

நாம் இதுவரை கண்ட இயந்திரக் கற்றல், ஆழக் கற்றல், மற்றும் உருவாக்கும் AI ஆகியவை ஒரு குறிப்பிட்ட களத்தில் தங்களின் முழுத் திறனையும் வெளிப்படுத்தும் மாயாஜாலக் களம்தான் மனித மொழி! அடுத்த அத்தியாயத்தில் மொழியின் புதிரையும் NLP-யின் அடிப்படைகளையும் ஆழமாக ஆராய்வோம்.